Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

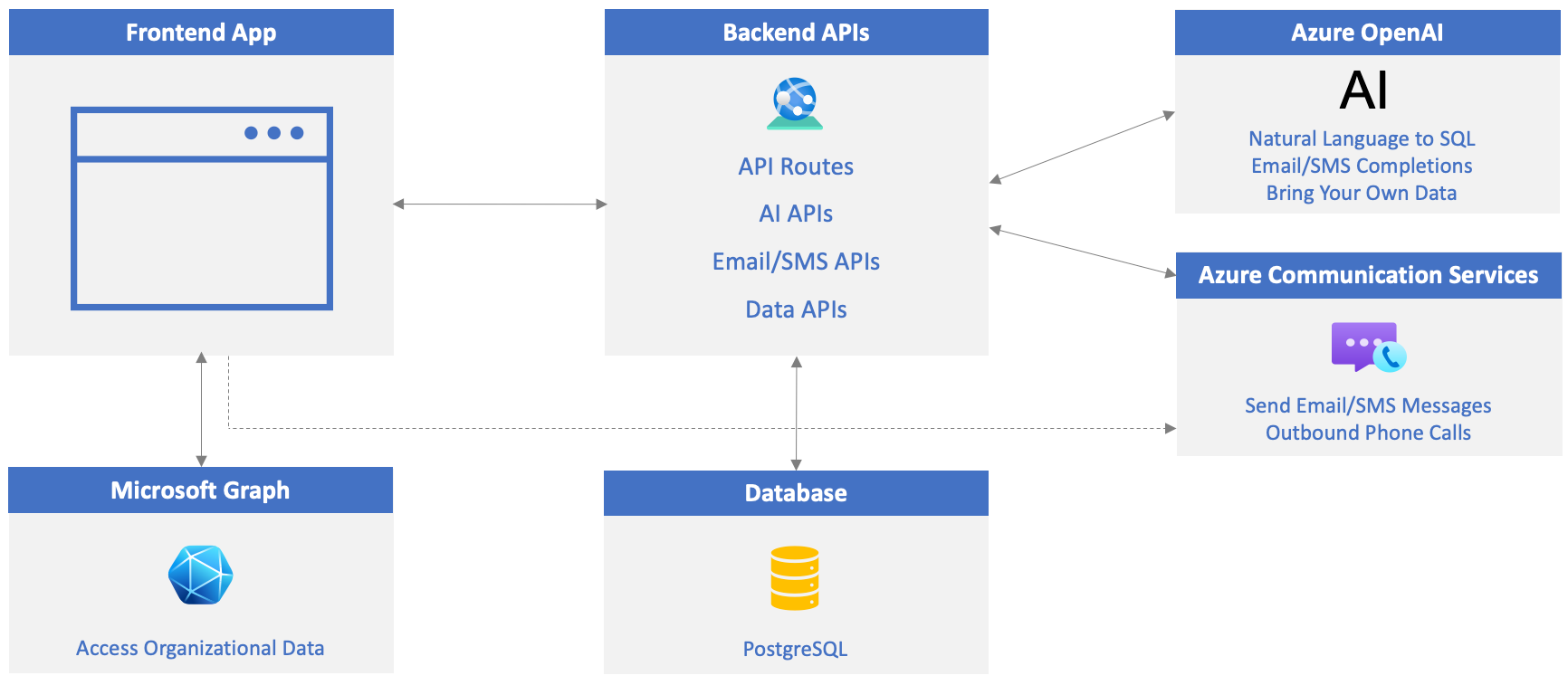

Para começar a usar o Azure OpenAI em seus aplicativos, você precisa criar um Serviço OpenAI do Azure e implantar um modelo que possa ser usado para executar tarefas como converter linguagem natural em SQL, gerar conteúdo de mensagem de email/SMS e muito mais.

Neste exercício, você vai:

- Crie um recurso do Serviço OpenAI do Azure.

- Implantar um modelo.

- Atualize o arquivo .env com valores do recurso de serviço do Azure OpenAI.

Criar um recurso de serviço OpenAI do Azure

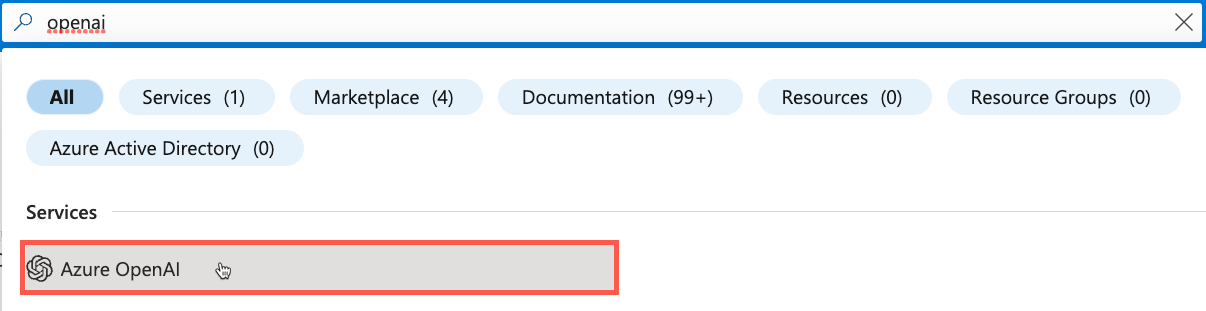

Visite o portal do Azure no navegador e entre.

Insira openai na barra de pesquisa na parte superior da página do portal e selecione Azure OpenAI nas opções exibidas.

Selecione Criar na barra de ferramentas.

Observação

Embora este tutorial se concentre no Azure OpenAI, se você tiver uma chave de API OpenAI e quiser usá-la, ignore esta seção e vá diretamente para a seção Atualizar o arquivo .env do Projeto abaixo. Atribua sua chave de API OpenAI no

OPENAI_API_KEYarquivo .env (você pode ignorar quaisquer outras.envinstruções relacionadas ao OpenAI).Os modelos OpenAI do Azure estão disponíveis em regiões específicas. Visite o documento de disponibilidade do modelo do Azure OpenAI para saber quais regiões dão suporte ao modelo gpt-4o usado neste tutorial.

Execute as seguintes tarefas:

- Selecione sua assinatura do Azure.

- Selecione o grupo de recursos a ser usado (crie um novo, se necessário).

- Selecione uma região onde o modelo gpt-4o é suportado com base no documento que você examinou anteriormente.

- Insira o nome do recurso. Ele precisa ser um valor exclusivo.

- Selecione o tipo de preço Standard S0 .

Selecione Avançar até chegar à tela Examinar + Enviar . Selecione Criar.

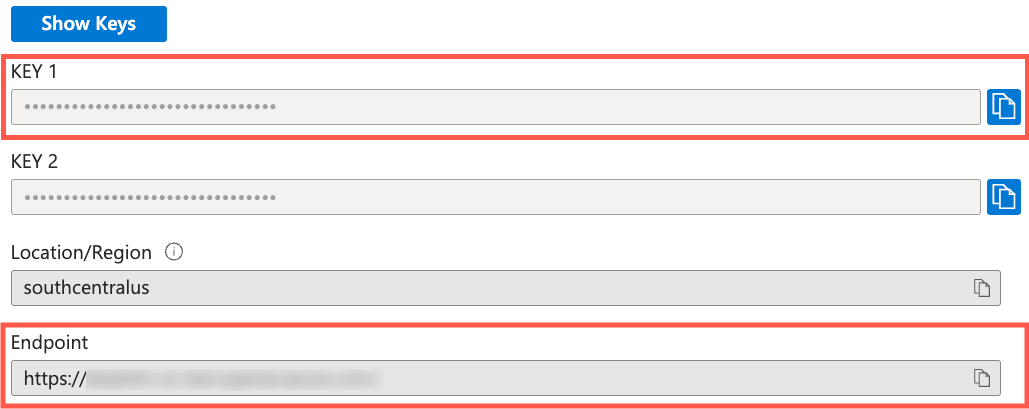

Depois que o recurso do Azure OpenAI for criado, navegue até ele e selecione Gerenciamento de Recursos -->Chaves e Ponto de Extremidade .

Localize os valores KEY 1 e Endpoint . Você usará os dois valores na próxima seção, portanto, copie-os para um arquivo local.

Selecione Gerenciamento de Recursos -->Implantações de modelo.

Selecione o botão Gerenciar Implantações para acessar o Azure OpenAI Studio.

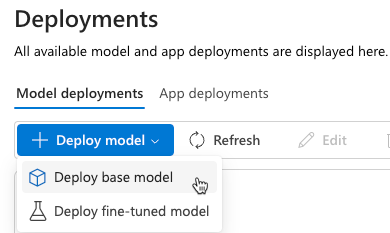

Selecione Implantar modelo -->Implantar modelo base na barra de ferramentas.

Selecione gpt-4o na lista de modelos e selecione Confirmar.

Observação

O Azure OpenAI dá suporte a vários tipos diferentes de modelos. Cada modelo pode ser usado para lidar com diferentes cenários.

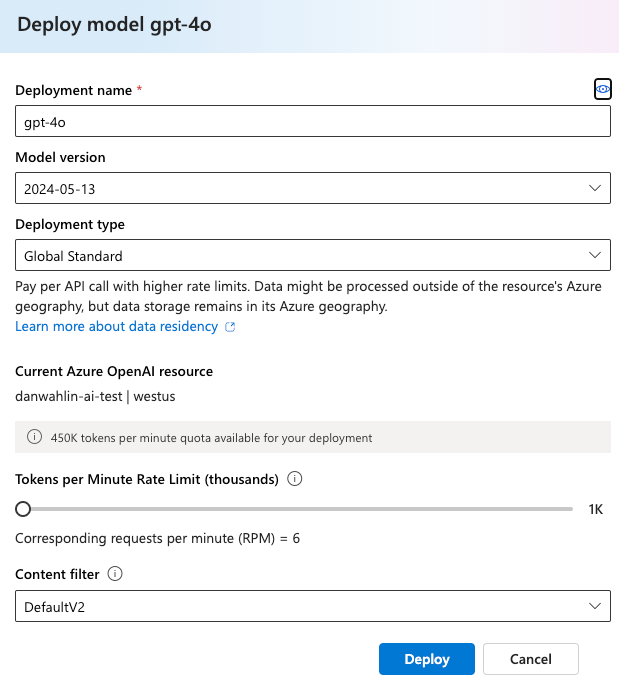

A caixa de diálogo a seguir será exibida. Reserve um momento para examinar os valores padrão fornecidos.

Altere o valor da taxa de tokens por minuto (milhares) para 100 mil. Isso permitirá que você faça mais solicitações ao modelo e evite atingir o limite de taxa ao executar as etapas a seguir.

Selecione Implantar.

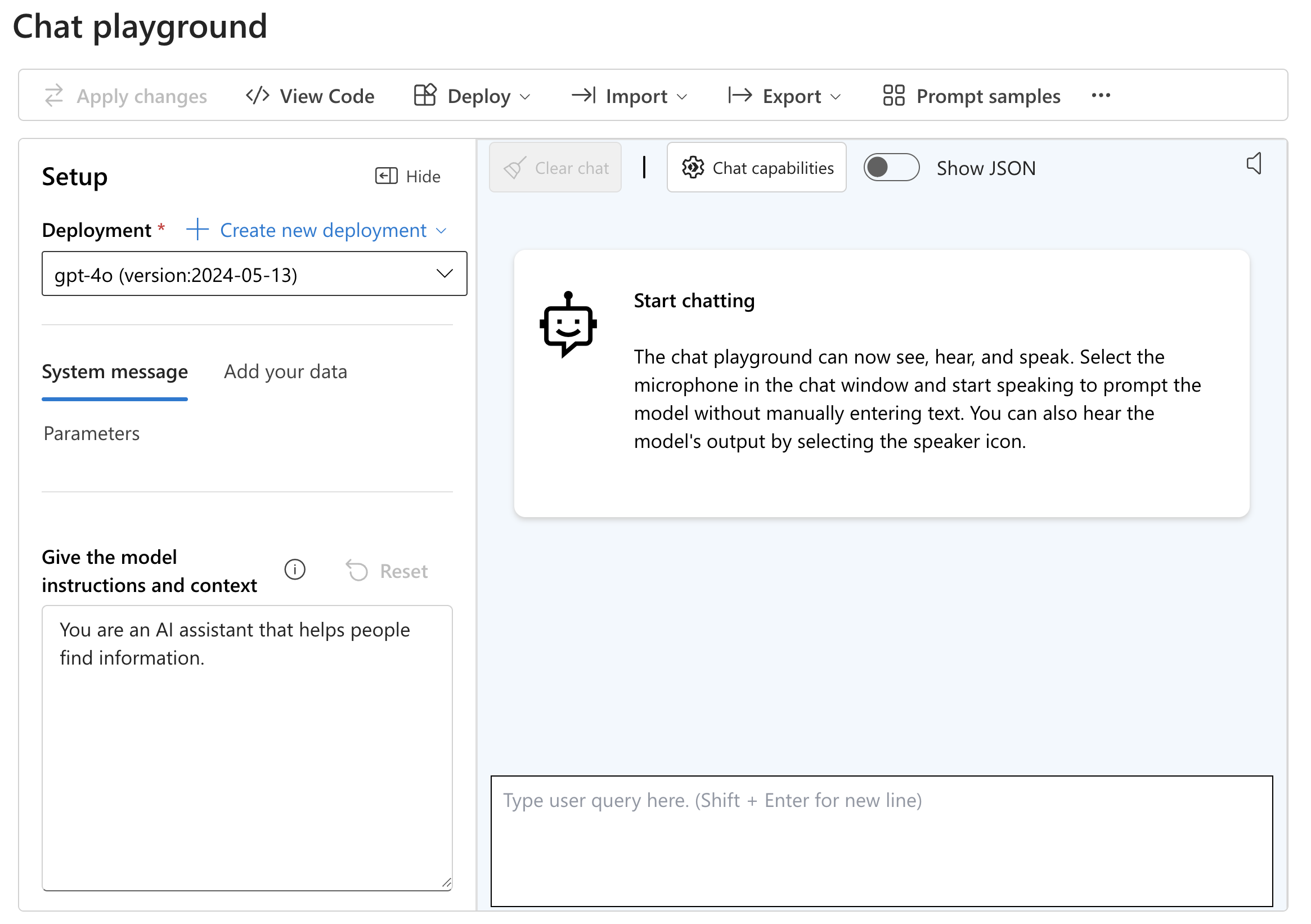

Depois que o modelo for implantado, selecione Playgrounds -->Chat.

A lista suspensa implantação deve exibir o modelo gpt-4o .

Reserve um momento para ler o texto da mensagem do sistema fornecido. Isso informa ao modelo como agir à medida que o usuário interage com ele.

Localize a caixa de texto na área de chat e insira Resumir o que é a IA do Generative e como ela pode ser usada. Selecione Enter para enviar a mensagem para o modelo e fazer com que ele gere uma resposta.

Experimente outros prompts e respostas. Por exemplo, insira Fornecer um breve histórico sobre a capital da França e observe a resposta gerada.

Atualizar o arquivo do .env projeto

Volte para o Visual Studio Code e abra o

.envarquivo na raiz do projeto.Copie o valor KEY 1 do recurso do Azure OpenAI e atribua-o ao

OPENAI_API_KEYarquivo .env localizado na raiz da pasta openai-acs-msgraph :OPENAI_API_KEY=<KEY_1_VALUE>Copie o valor do *Ponto de Extremidade e atribua-o ao

OPENAI_ENDPOINTarquivo .env . Remova o/caractere do final do valor, se ele estiver presente.OPENAI_ENDPOINT=<ENDPOINT_VALUE>Observação

Você verá esses valores e

OPENAI_MODELOPENAI_API_VERSIONjá está definido no arquivo .env . O valor do modelo é definido como gpt-4o , que corresponde ao nome de implantação do modelo criado anteriormente neste exercício. A versão da API é definida como um valor com suporte definido na documentação de referência do Azure OpenAI.Salve o arquivo .env .

Inicie os serviços de aplicativos

É hora de iniciar seus serviços de aplicativos, incluindo o banco de dados, o servidor de API e o servidor web.

Nas etapas a seguir, você criará três janelas de terminal no Visual Studio Code.

Clique com o botão direito do mouse no arquivo .env na lista de arquivos do Visual Studio Code e selecione Abrir no Terminal Integrado. Verifique se o terminal está na raiz do projeto - openai-acs-msgraph - antes de continuar.

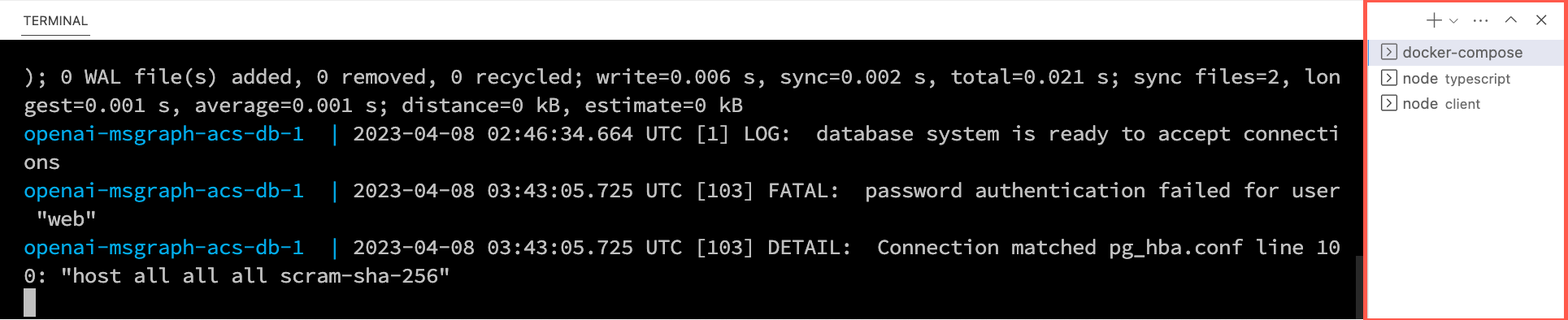

Escolha uma das seguintes opções para iniciar o banco de dados PostgreSQL:

Se você tiver o Docker Desktop instalado e em execução, execute

docker-compose upna janela do terminal e pressione Enter.Se você tiver o Podman com podman-compose instalado e em execução, execute

podman-compose upna janela do terminal e pressione Enter.Para executar o contêiner do PostgreSQL diretamente usando o Docker Desktop, o Podman, o nerdctl ou outro tempo de execução do contêiner que você instalou, execute o seguinte comando na janela do terminal:

Subsistema Mac, Linux ou Windows para Linux (WSL):

[docker | podman | nerdctl] run --name postgresDb -e POSTGRES_USER=web -e POSTGRES_PASSWORD=web-password -e POSTGRES_DB=CustomersDB -v $(pwd)/data:/var/lib/postgresql/data -p 5432:5432 postgresWindows com PowerShell:

[docker | podman] run --name postgresDb -e POSTGRES_USER=web -e POSTGRES_PASSWORD=web-password -e POSTGRES_DB=CustomersDB -v ${PWD}/data:/var/lib/postgresql/data -p 5432:5432 postgres

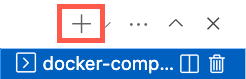

Depois que o contêiner de banco de dados for iniciado, pressione o + ícone na barra de ferramentas do Terminal do Visual Studio Code para criar uma segunda janela de terminal.

cdna pasta servidor/typescript e execute os comandos a seguir para instalar as dependências e iniciar o servidor de API.npm installnpm start

Pressione o + ícone novamente na barra de ferramentas do Terminal do Visual Studio Code para criar uma terceira janela de terminal.

cdna pasta do cliente e execute os comandos a seguir para instalar as dependências e iniciar o servidor Web.npm installnpm start

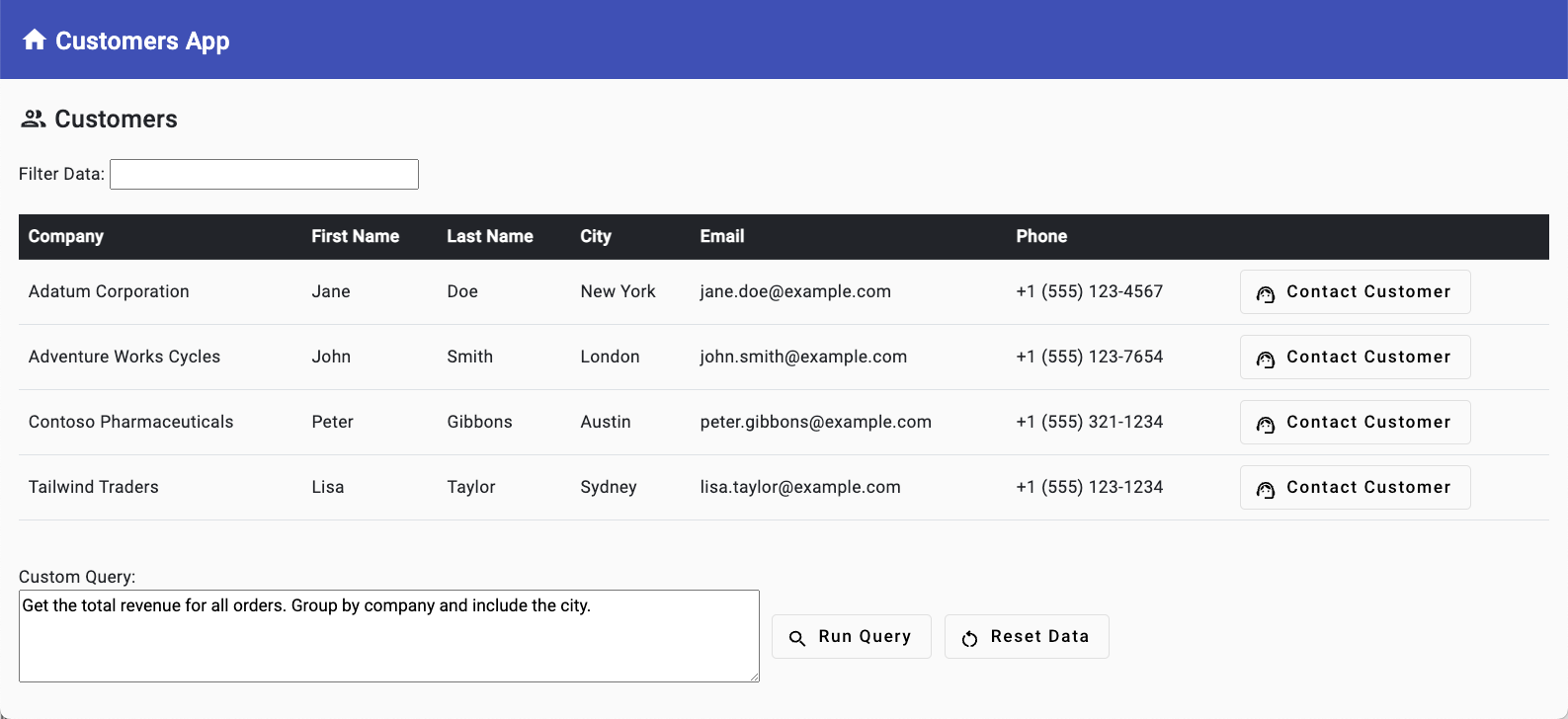

Um navegador será iniciado e você será direcionado para http://localhost:4200.