Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Orientações de licenciamento do Microsoft 365 para conformidade com & de segurança

Utilize as secções seguintes para identificar as capacidades do Microsoft Purview que são suportadas para interações de IA com agentes incorporados no Microsoft Copilot Studio e algumas recomendações de introdução para gerir estas interações de IA para segurança e conformidade.

Gerir estas interações de IA para Copilot Studio agentes publicados em canais que não sejam da Microsoft requer que ative a faturação pay as you go na sua organização.

Recursos com suporte

Utilize a tabela seguinte para ver rapidamente as capacidades do Microsoft Purview que são suportadas com agentes incorporados Copilot Studio.

| Capacidade ou solução no Microsoft Purview | Suportado para interações de IA |

|---|---|

| DSPM para IA (clássico) e DSPM (pré-visualização) | ✓ |

| Auditoria | ✓ |

| Classificação de dados | ✓ |

| Rótulos de confidencialidade | ✓ |

| Encriptação sem etiquetas de confidencialidade | ✕ |

| Prevenção contra perda de dados | ✓ |

| Gerenciamento de Risco Interno | ✓ |

| Conformidade em comunicações | ✓ |

| Descoberta eletrônica | ✓ |

| Gerenciamento do Ciclo de Vida dos Cados | ✓ |

| Gerenciador de Conformidade | ✓ |

DSPM para IA (clássico) e DSPM (pré-visualização)

Utilize Gerenciamento da Postura de Segurança de Dados para IA (clássico) ou Gerenciamento da Postura de Segurança de Dados (pré-visualização) como porta de entrada para detetar, proteger e aplicar controlos de conformidade para a utilização de IA na sua empresa. Ambas as versões DSPM utilizam controlos existentes da gestão de conformidade e proteção de informações do Microsoft Purview com ferramentas gráficas e relatórios fáceis de utilizar para obter rapidamente informações sobre a utilização de IA na sua organização. Com recomendações personalizadas e políticas de um clique ajudam-no a proteger os seus dados e a cumprir os requisitos regulamentares.

Informações específicas da aplicação de IA:

Recomendação Obtenha assistência orientada para os regulamentos de IA, que utilizam modelos regulamentares de mapeamento de controlo do Gestor de Conformidade.

Políticas de um clique disponíveis:

- DSPM para IA – detete a utilização de IA de risco na ação de recomendação ou remediação Detetar interações de risco nas aplicações de IA.

- DSPM para IA – Comportamento não ético nas aplicações de IA a partir da ação de recomendação ou remediação Detetar comportamento não ético nas aplicações de IA

- DSPM para IA – detete informações confidenciais partilhadas com a IA através da rede a partir da ação de recomendação ou remediação Expanda as informações em dados confidenciais nas interações da aplicação de IA.

Auditoria e interações de IA

Auditoria do Microsoft Purview soluções fornecem ferramentas abrangentes para pesquisar e gerir registos de auditoria de atividades realizadas em vários serviços Microsoft por utilizadores e administradores e ajudar as organizações a responder eficazmente a eventos de segurança, investigações forenses, investigações internas e obrigações de conformidade.

Tal como outras atividades, os pedidos e as respostas são capturados no registo de auditoria unificado. Os eventos incluem como e quando os utilizadores interagem com a aplicação de IA e podem incluir em que serviço do Microsoft 365 a atividade ocorreu e referências aos ficheiros armazenados no Microsoft 365 que foram acedidos durante a interação. Se estes ficheiros tiverem uma etiqueta de confidencialidade aplicada, também é capturada.

Estes eventos fluem para o explorador de atividades no DSPM para IA e o separador Atividades de IA no explorador de atividades a partir da versão de pré-visualização do DSPM, onde os dados de pedidos e respostas podem ser apresentados. Também pode utilizar a solução Auditoria do portal do Microsoft Purview para procurar e encontrar estes eventos de auditoria.

Para obter mais informações, veja Registos de auditoria para atividades de Copilot e IA.

Classificação de dados e interações de IA

A classificação de dados do Microsoft Purview fornece uma arquitetura abrangente para identificar e identificar dados confidenciais em vários serviços Microsoft, incluindo Office 365, Dynamics 365 e Azure. Classificar dados é, muitas vezes, o primeiro passo para garantir a conformidade com os regulamentos de proteção de dados e proteger contra o acesso, alteração ou destruição não autorizados. Pode utilizar classificações de sistema incorporadas ou criar as suas próprias.

Os tipos de informações confidenciais e classificadores treináveis podem ser utilizados para localizar dados confidenciais em pedidos de utilizador e respostas quando utilizam aplicações de IA. Em seguida, as informações resultantes são apresentadas na descrição geral dos Relatórios do Microsoft Purview e no explorador de atividades no DSPM para IA e no separador Atividades de IA no explorador de atividades a partir da versão de pré-visualização do DSPM.

Etiquetas de confidencialidade e interações de IA

As aplicações de IA suportadas pelo Microsoft Purview utilizam controlos existentes para garantir que os dados armazenados no seu inquilino nunca são devolvidos ao utilizador ou utilizados por um modelo de linguagem grande (LLM) se o utilizador não tiver acesso a esses dados. Quando os dados têm etiquetas de confidencialidade da sua organização aplicadas ao conteúdo, existe uma camada adicional de proteção:

Quando um ficheiro é aberto no Word, Excel, PowerPoint ou, da mesma forma, um evento de e-mail ou calendário é aberto no Outlook, a confidencialidade dos dados é apresentada aos utilizadores na aplicação com o nome da etiqueta e marcações de conteúdo (como texto de cabeçalho ou rodapé) que foram configurados para a etiqueta. Loop componentes e páginas também suportam as mesmas etiquetas de confidencialidade.

Quando a etiqueta de confidencialidade aplica encriptação, os utilizadores têm de ter o direito de utilização EXTRAÇÃO, bem como VER, para que as aplicações de IA devolvam os dados.

Essa proteção se estende a dados armazenados fora do seu locatário do Microsoft 365 quando abertos em um aplicativo do Office (dados em uso). Por exemplo, armazenamento local, compartilhamentos de rede e armazenamento em nuvem.

Dica

Se ainda não o fez, recomendamos que ative as etiquetas de confidencialidade para o SharePoint e o OneDrive e também se familiarize com os tipos de ficheiro e as configurações de etiquetas que estes serviços podem processar. Quando as etiquetas de confidencialidade não estão ativadas para estes serviços, os ficheiros encriptados aos quais o Copilot e os agentes podem aceder estão limitados aos dados utilizados a partir das aplicações do Office no Windows.

Para obter instruções, consulte Habilitar rótulos de confidencialidade para arquivos do Office no Microsoft Office SharePoint Online e no OneDrive.

Se você ainda não estiver usando rótulos de confidencialidade, consulte Introdução aos rótulos de confidencialidade.

Informações específicas da aplicação de IA:

- Suportado quando a origem de conhecimento é o SharePoint (inclui o OneDrive) e o Dataverse com políticas de etiquetagem automática para o Mapa de Dados.

- A encriptação só é suportada com etiquetas de confidencialidade e apenas para a origem de conhecimento do SharePoint.

- Tal como as etiquetas de confidencialidade no Microsoft 365 Chat, os agentes incorporados Copilot Studio apresentar a etiqueta de confidencialidade dos itens listados na resposta e citações. Ao utilizar o número de prioridade das etiquetas de confidencialidade definido no portal do Microsoft Purview, a resposta mais recente em Copilot apresenta a etiqueta de confidencialidade de prioridade mais alta a partir dos dados utilizados para essa conversa copilot.

- Tal como a herança de etiquetas de confidencialidade para Microsoft 365 Copilot, o conteúdo recentemente criado do Word e o PowerPoint herda a etiqueta de confidencialidade de prioridade mais alta.

Prevenção de perda de dados e interações de IA

Prevenção Contra Perda de Dados do Microsoft Purview (DLP) ajuda-o a identificar itens confidenciais em todos os serviços e pontos finais do Microsoft 365, a monitorizá-los e a protegê-los contra fugas desses itens. Utiliza a inspeção de conteúdo profunda e a análise contextual para identificar itens confidenciais e impõe políticas para proteger dados confidenciais, como registos financeiros, informações de saúde ou propriedade intelectual.

Os computadores Windows integrados no Microsoft Purview podem ser configurados para políticas de prevenção de perda de dados de Ponto final (DLP) que avisam ou impedem os utilizadores de partilhar informações confidenciais com sites de IA geradores de terceiros que são acedidos através de um browser. Por exemplo, um utilizador é impedido de colar card números de crédito no ChatGPT ou vê um aviso a indicar que pode substituir. Para obter mais informações sobre as ações DLP suportadas e as plataformas que as suportam, consulte as duas primeiras linhas na tabela a partir das atividades do Ponto final que pode monitorizar e tomar medidas.

Informações específicas da aplicação de IA:

A seguinte capacidade DLP de Ponto Final só é suportada:

- Quando a origem de conhecimento é o SharePoint, uma política DLP no âmbito da localização Microsoft 365 Copilot pode restringir os agentes incorporados no Copilot Studio do Microsoft Teams, SharePoint e Microsoft 365 Copilot do processamento de conteúdos confidenciais com base numa etiqueta de confidencialidade especificada.

Interações de IA e Gestão de Riscos Internos

Gerenciamento de Risco Interno do Microsoft Purview ajuda-o a detetar, investigar e mitigar riscos internos, como roubo de IP, fuga de dados e violações de segurança. Tira partido de modelos de machine learning e de vários sinais do Microsoft 365 e de indicadores de terceiros para identificar potenciais atividades maliciosas ou inadvertidas do Insider. A solução inclui controlos de privacidade, como pseudonimização e acesso baseado em funções, garantindo a privacidade ao nível do utilizador, ao mesmo tempo que permite que os analistas de risco tomem as medidas adequadas.

Utilize o modelo de política de utilização de IA de Risco para detetar uma utilização arriscada que inclui ataques de injeção rápida e acesso a materiais protegidos. As informações destes sinais estão integradas no Microsoft Defender XDR para fornecer uma vista abrangente dos riscos relacionados com a IA.

Conformidade de comunicação e interações de IA

Conformidade de Comunicações do Microsoft Purview fornece ferramentas para o ajudar a detetar e gerir a conformidade regulamentar e as violações de conduta empresarial em vários canais de comunicação, que incluem pedidos de utilizador e respostas para aplicações de IA. Foi concebido com privacidade por predefinição, pseudonimizando nomes de utilizador e incorporando controlos de acesso baseados em funções. A solução ajuda a identificar e remediar comunicações inadequadas, como a partilha de informações confidenciais, assédio, ameaças e conteúdos para adultos.

Para saber mais sobre como utilizar políticas de conformidade de comunicação para aplicações de IA, veja Configurar uma política de conformidade de comunicação para detetar interações de IA geradoras.

Deteção de Dados Eletrónicos e interações de IA

Descoberta Eletrônica do Microsoft Purview permite-lhe identificar e fornecer informações eletrónicas que podem ser utilizadas como prova em casos legais. As ferramentas de Deteção de Dados Eletrónicos no Microsoft Purview suportam a pesquisa de conteúdos nas equipas de Exchange Online, OneDrive for Business, SharePoint Online, Microsoft Teams, Grupos do Microsoft 365 e Viva Engage. Em seguida, pode impedir que as informações sejam eliminados e exportar as informações.

Uma vez que os pedidos de utilizador e as respostas das aplicações de IA são armazenados na caixa de correio de um utilizador, pode criar um caso e utilizar a pesquisa quando a caixa de correio de um utilizador está selecionada como a origem de uma consulta de pesquisa. Por exemplo, selecione e obtenha estes dados da caixa de correio de origem ao selecionar a partir do construtor de consultas Adicionartipo> de >condição>Contém qualqueratividadeEditar>Copilot. Esta condição de consulta inclui toda a atividade copilot e outra aplicação de IA.

Depois de refinada a pesquisa, pode exportar os resultados ou adicionar a um conjunto de revisões. Pode rever e exportar informações diretamente a partir do conjunto de revisões.

Para saber mais sobre como identificar e eliminar dados de interação de IA do utilizador, veja Procurar e eliminar dados do Copilot na Deteção de Dados Eletrónicos.

Gestão do Ciclo de Vida de Dados e interações de IA

Gerenciamento do Ciclo de Vida dos Dados do Microsoft Purview fornece ferramentas e capacidades para gerir o ciclo de vida dos dados organizacionais ao manter os conteúdos necessários e eliminar conteúdos desnecessários. Estas ferramentas garantem a conformidade com os requisitos comerciais, legais e regulamentares.

Utilize políticas de retenção para reter ou eliminar automaticamente pedidos de utilizador e respostas para aplicações de IA. Para obter informações detalhadas sobre este trabalho de retenção, veja Saiba mais sobre a retenção para aplicações copilot & IA.

Tal como acontece com todas as políticas de retenção e retenções, se mais do que uma política para a mesma localização se aplicar a um utilizador, os princípios de retenção resolve quaisquer conflitos. Por exemplo, os dados são retidos pela maior duração de todas as políticas de retenção aplicadas ou bloqueios de Descoberta Eletrônica.

Informações específicas da aplicação de IA:

- Para políticas de retenção, selecione a opção para Microsoft Copilot Experiências.

Interações de IA e Gestor de Conformidade

O Gestor de Conformidade do Microsoft Purview é uma solução que o ajuda a avaliar e gerir automaticamente a conformidade em todo o seu ambiente multicloud. O Gerenciador de Conformidade pode ajudá-lo durante todo o percurso de conformidade, incluindo desde fazer um inventário dos riscos de proteção de dados até gerenciar as complexidades de implementação de controles, mantendo-o atualizado quanto aos regulamentos e certificações e enviando relatórios para auditores.

Para o ajudar a manter-se em conformidade com os regulamentos de IA, o Gestor de Conformidade fornece modelos regulamentares para o ajudar a avaliar, implementar e reforçar os seus requisitos de conformidade para todas as aplicações de IA geradoras. Por exemplo, monitorizar interações de IA e impedir a perda de dados em aplicações de IA. Para obter mais informações, veja Avaliações de regulamentos de IA.

Passos recomendados de introdução

Utilize os seguintes passos para começar a gerir a segurança de dados & conformidade para interações de agentes incorporados no Microsoft Copilot Studio.

Observação

Estes passos focam-se na gestão de uma aplicação ou agente de IA específico. Para uma cobertura mais ampla que utiliza objetivos de segurança com fluxos de trabalho guiados, utilize o novo Gerenciamento da Postura de Segurança de Dados, atualmente em pré-visualização.

Uma vez que Gerenciamento da Postura de Segurança de Dados para IA é o seu front door para proteger e gerir interações de IA, a maioria das seguintes instruções utiliza essa solução:

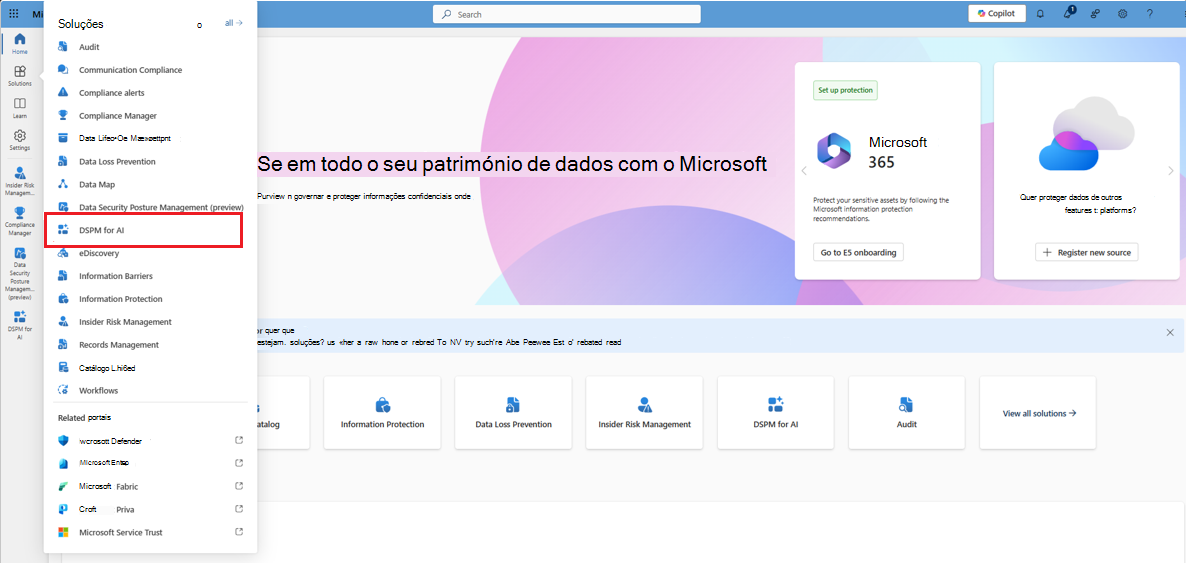

Iniciar sessão no portal> do Microsoft PurviewSoluções>DSPM para IA (clássica) com uma conta com as permissões adequadas. Por exemplo, uma conta que seja membro da função de grupo Administrador de Conformidade do Microsoft Entra.

Descobrir potenciais riscos de segurança nas interações Microsoft Copilot Studio

No DSPM para IA (clássico)>Descrição geral, na secção Introdução, veja se a auditoria está ativada para o seu inquilino. Caso contrário, selecione Ativar Auditoria do Microsoft Purview.

Na secção Recomendações , selecione Ver todas as recomendações para o levar à página Recomendações . Se a seguinte recomendação tiver uma status de Não Iniciada, tome medidas para criar uma política de um clique:

- Detetar interações de risco em aplicações de IA: esta recomendação cria uma política para ajudar a calcular o risco do utilizador ao detetar pedidos e respostas de risco em Microsoft 365 Copilot, agentes e outras aplicações de IA geradoras.

Aguarde pelo menos um dia pelos dados e, em seguida, navegue para a página Relatórios para ver os resultados da sua política. Selecione Experiências de copilot & agentes e veja informações como:

- Total de interações ao longo do tempo (Microsoft Copilot e agentes)

- Interações confidenciais por aplicação de IA

- Principais interações de IA não éticas

- Gravidade do Risco Interno

- Gravidade do risco interno por aplicação de IA

- Potencial utilização de IA de risco

Selecione Ver detalhes para cada um dos gráficos de relatório para ver atividades detalhadas no explorador de atividades.

Nos filtros, selecione a categoria da aplicação de IA de experiências copilot & agentes e, em seguida, utilize os outros filtros se precisar de refinar ainda mais os dados apresentados. Em seguida, desagregue para cada atividade para ver os detalhes que incluem apresentar os pedidos e a resposta quando for membro do grupo de funções Visualizador de Conteúdos do Microsoft Purview Explorer. Para obter mais informações sobre este requisito, veja Permissões para Gerenciamento da Postura de Segurança de Dados para IA.

Aplicar controlos de conformidade a Microsoft Copilot Studio

Na página recomendaçõesDSPM para IA (clássico),> em Não Iniciada, localize e selecione e tome medidas na seguinte recomendação:

- Detetar comportamento não ético na IA: esta recomendação cria uma política para detetar informações confidenciais em pedidos e respostas em agentes incorporados Copilot Studio e outras aplicações de IA geradoras.

Se precisar de garantir que as interações dos agentes incorporados no Copilot Studio são mantidas por motivos de conformidade:

No portal do Microsoft Purview, navegue paraPolíticas de Retenção dePolíticas> de Gestão> do Ciclo de Vida de Dados e crie uma política de retenção para manter Microsoft Security Copilot interações ao selecionar a localização Microsoft Copilot Experiências e especificar o período de retenção necessário. Para obter mais informações, veja Criar e configurar políticas de retenção.

Se precisar de preservar, recolher, analisar, rever ou exportar interações Microsoft Copilot Studio:

No portal do Microsoft Purview, navegue para Casos de Deteção> de DadosEletrónicos>Criar caso. No caso, crie uma pesquisa e utilize a propriedade ItemClass e o

IPM.SkypeTeams.Message.Copilot.Studio.*valor para procurar estas interações na sua organização.

Reveja rotineiramente os relatórios e as avaliações de risco de dados no DSPM para IA para determinar se precisa de fazer alterações e utilize o explorador de atividades e eventos para uma análise mais aprofundada de como os utilizadores estão a interagir com agentes incorporados Copilot Studio.